|

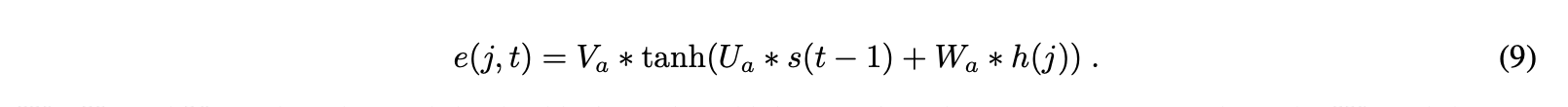

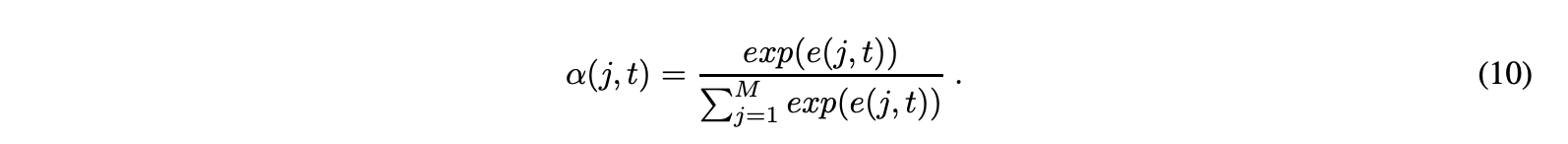

Wa、Ua和Va是这个公式中的学习权重,它们被称为注意权重。Wa权重链接到编码器的隐藏状态,Ua权重链接到解码器的隐藏状态,Va权重确定计算对齐分数的函数。分数e(j,t)在编码器j的时间段上使用softmax函数在每个时间步t处归一化,获得如下注意权重α(j,t):

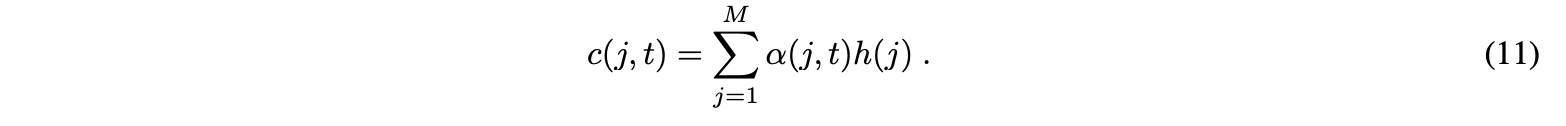

时间j处的输入的重要性由用于解码时间t的输出的注意权重α(j,t)表示。根据作为编码器的所有隐藏值的加权和的注意权重来估计上下文向量c(t),如下所示:

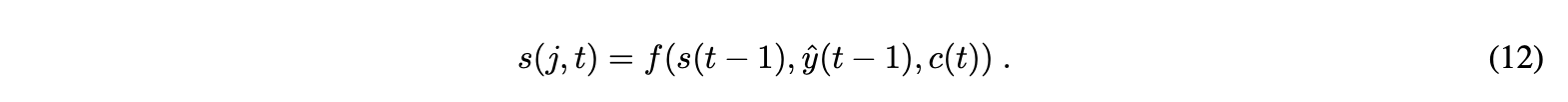

根据这种方法,所谓的注意功能是由上下文数据向量触发的,对最重要的输入进行加权。 上下文向量c(t)现在被转发到解码器以计算下一个可能输出的概率分布。此解码操作涉及输入中存在的所有时间步长。然后根据循环单位函数计算当前隐藏状态s(t),将上下文向量c(t)、隐藏状态s(t−1)和输出yˆ(t−1)作为输入,根据以下等式:

利用该函数,模型可以识别输入序列不同部分与输出序列相应部分之间的关系。softmax函数用于在每个时刻t计算处于加权隐藏状态的解码器的输出:

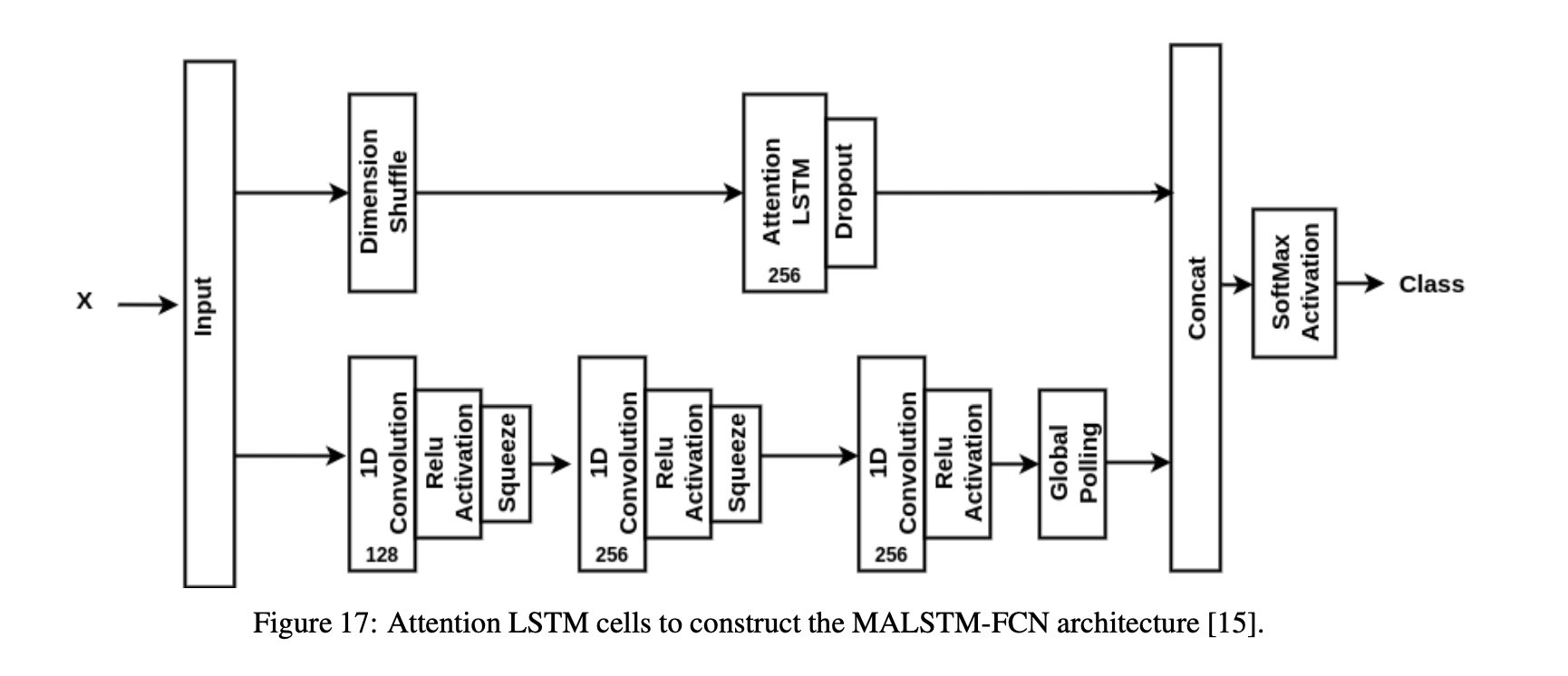

对于LSTM,由于注意权值的存在,注意机制在长输入序列下提供了更好的结果。 在这项研究中,我们特别使用了Fazle等人提出的具有完全卷积网络的多元注意LSTM(MALSTM-FCN)。图17显示了MALSTM-FCN的体系结构,包括每层的神经元数量。输入序列与完全卷积层和注意LSTM层并行,并通过用于二进制分类的softmax激活函数连接和传递到输出层。全卷积块包含三个分别由128、256和256个神经元组成的时间卷积块,用作特征抽取器。在级联之前,每个卷积层通过批量归一化来完成。维洗牌变换输入数据的时间维,使得LSTM一次获得每个变量的全局时间信息。因此,对于时间序列分类问题,维数洗牌操作减少了训练和推理的计算时间,同时又不损失精度[15]。

3.4 卷积神经网络 卷积神经网络(CNN)是一类特殊的神经网络,最常用于图像处理、图像分类、自然语言处理和金融时间序列分析等深度学习应用[6]。 CNN架构中最关键的部分是卷积层。这层执行一个称为卷积的数学运算。在这种情况下,卷积是一种线性运算,它涉及输入数据矩阵和二维权值数组(称为滤波器)之间的乘法。这些网络在至少一层中使用卷积运算。 (责任编辑:admin) |